Nel 2012, la ImageNet Challenge era giunta alla sua terza edizione. Ufficialmente noto come ImageNet Large Scale Visual Recognition Challenge, il concorso era stato lanciato nel 2010 dalla docente di Stanford Fei-Fei Li per permettere ai migliori software di riconoscimento immagini (in grado quindi di riconoscere gli oggetti o gli esseri viventi presenti in una fotografia) di sfidarsi, premiando il più preciso ad analizzare correttamente le immagini presenti nel database.

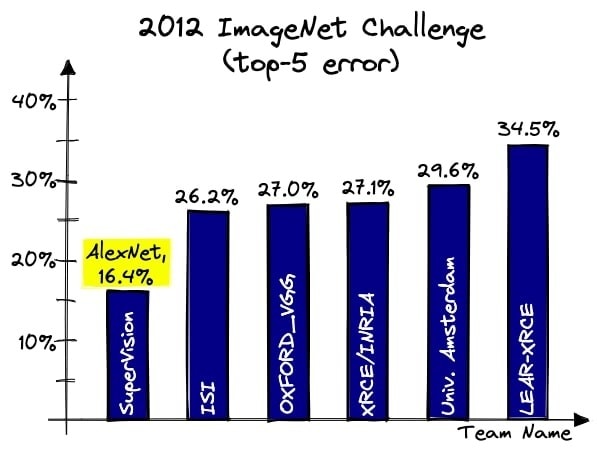

In quel 2012, gli algoritmi di computer vision che fino ad allora avevano dominato la competizione – tutti basati su una tecnologia nota come SVM (support vector machines) – vennero stracciati da una rete neurale battezzata AlexNet, che raggiunse un livello di accuratezza pari all’85% laddove tutti gli altri non avevano mai superato il 74%.

Com’era potuto avvenire un salto del genere, così all’improvviso? AlexNet era una rete neurale profonda (deep neural network) basata su machine learning. Un’architettura informatica modellata, grosso modo, sul funzionamento del cervello umano e che apprende in autonomia dai dati. Per insegnare a un sistema di questo tipo, per esempio, a riconoscere dei gatti, nessun programmatore “spiega” al software quali siano le caratteristiche tipiche dei gatti, si limita invece a dare in pasto al sistema centinaia di migliaia di immagini di gatti (e altrettante di animali diversi) finché l’algoritmo – seguendo un processo di tentativi ed errori – non impara da solo a riconoscere i gatti e a distinguerli da altri animali.

In sintesi estrema, il sistema analizza le immagini che gli sono state fornite e cerca di individuare le caratteristiche dei gatti: ogni volta che sbaglia la sua previsione, il percorso all’interno della rete neurale che ha portato all’errore viene indebolito; ogni volta che invece indovina la previsione, il percorso viene rafforzato (un processo tecnicamente chiamato “retropropagazione dell’errore”).

È un apprendimento “dal basso”, statistico, diametralmente opposto all’approccio simbolico in voga fino a quel momento, quando si riteneva che si dovessero dotare i programmi di tutte le regole necessarie per portare a termine un compito (specificando, per esempio, ogni caratteristica di un gatto affinché imparasse a riconoscerlo).

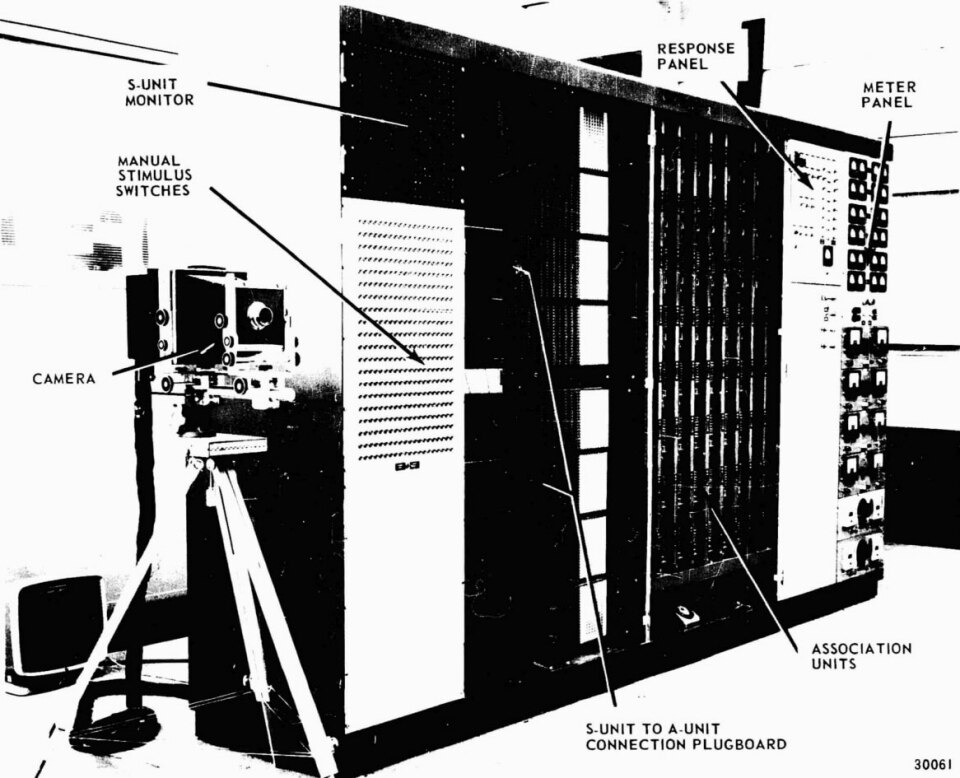

A stupire gli addetti ai lavori non fu soltanto l’improvviso progresso portato da questi sistemi, ma soprattutto il fatto che quella delle reti neurali era considerata una tecnologia vecchia, superata dal tempo e incapace di mantenere le promesse. Già nel 1958 lo psicologo Frank Rosenblatt aveva presentato il Mark I Perceptron, un enorme sistema composto da un groviglio di cavi e fotocellule: il primo tentativo di creare una macchina capace di imparare direttamente dai dati. L’esperimento, però, naufragò, a causa della semplicità della rete neurale, della mancanza di potenza di calcolo e della scarsità di dati utilizzabili per addestrare il sistema.

Nel 1969, Marvin Minsky, storico paladino dell’intelligenza artificiale simbolica, demolì matematicamente il progetto nel saggio Perceptrons (scritto assieme a Seymour Papert) e convinse il mondo accademico a voltargli le spalle. Seguì un periodo, lungo svariati decenni e noto come l'inverno delle intelligenze artificiali, in cui le reti neurali furono abbandonate da tutti.

In realtà, le reti neurali non erano però state abbandonate da tutti i ricercatori: alcuni di loro – tra cui i “padrini” dell’intelligenza artificiale: Geoff Hinton (supervisore di AlexNet), Yann LeCun e Yoshua Bengio – continuavano a lavorarci quasi in clandestinità, convinti che, nonostante le difficoltà, fosse quella la strada migliore per conquistare il Sacro Graal tecnologico dell’intelligenza artificiale (cioè la capacità delle macchine di apprendere e svolgere compiti tipici dell’intelligenza umana).

Nell’intelligenza artificiale non c’è intelligenza, ma solo dei calcoli statistici estremamente complessi. Questo, però, non ha impedito al deep learning di cambiare per sempre il mondo in cui viviamo.

Il problema non erano le limitazioni intrinseche delle reti neurali o degli algoritmi di machine learning. Non era la teoria alla base già del Perceptron a essere sbagliata. Era il progresso tecnologico che, nei decenni precedenti, non era stato in grado di fornire gli strumenti adatti affinché le reti neurali esprimessero tutte le loro potenzialità.

Negli anni Dieci del nuovo millennio la situazione stava però rapidamente cambiando. Da una parte, internet aveva permesso un’esplosione di dati che adesso potevano essere sfruttati per creare i database necessari ad addestrare le reti neurali. Dall’altra, la potenza di calcolo a disposizione degli scienziati continuava a crescere.

Il 2012 rappresenta quindi il momento della rivincita: l’anno in cui il machine learning (e poi il deep learning, in cui il termine “profondo” indica l’aumento del numero di strati all’interno delle reti neurali) dimostrò di poter ottenere risultati che per i sistemi simbolici erano impossibili da raggiungere.

È per questo che il 2012 è diventato noto come l’anno del “big bang del deep learning” e, per estensione, dell’intelligenza artificiale. Che da quel momento si è diffusa ovunque e ha letteralmente cambiato il mondo, venendo impiegata negli algoritmi che consigliano cosa comprare, ascoltare o guardare e in quelli, ben più importanti, che filtrano curriculum, stabiliscono la solvibilità di un prestito o affiancano i radiologi nell’individuare un tumore. Sanità, intrattenimento, sicurezza, istruzione, sport, finanza: non esiste settore immune all’apprendimento automatico, che scova correlazioni in un mare di dati e tramite esse, al netto dei possibili errori, effettua previsioni spesso molto accurate.

È un insieme di sistemi chiamati “algoritmi predittivi”, a cui negli ultimi anni si sono affiancati gli “algoritmi generativi”. A partire dal 2022, i cosiddetti large language model (a partire da ChatGPT) hanno dimostrato di poter generare testi coerenti e rispondere in maniera verosimile a domande di ogni tipo, mentre altri sistemi generativi sono in grado di creare immagini (Midjourney), video (Sora) o musica (Suno) con risultati spesso sorprendenti.

Anche se l’esito finale è diverso, la struttura di base resta la stessa: una rete neurale profonda che apprende dai dati. L’unica vera differenza è che l’output non è più una classificazione (“questa è la foto di un cane”), ma una previsione più complessa: la parola successiva in una frase, il pixel mancante in un’immagine, la nota successiva in una melodia.

Intelligenza artificiale predittiva e generativa condividono quindi lo stesso funzionamento statistico: si tratta sempre di software che individuano pattern nei dati per generare una previsione probabilisticamente plausibile. Nell’intelligenza artificiale – termine inventato nel 1956 dall’informatico John McCarthy – non c’è quindi intelligenza, ma solo dei calcoli statistici estremamente complessi. Questo, però, non ha impedito al deep learning di cambiare per sempre il mondo in cui viviamo.